AI硬件产业链正在从单一算力芯片扩张,延伸到光互联、电源架构、PCB材料、电子布、特种布、树脂、MLCC等上游环节。近期市场围绕CPO出货节奏、保偏光纤用量、CPO良率、800V HVDC、T布和Q布供需、Rubin Ultra材料方案等问题出现较多分歧,其中不少讨论存在误读或过度放大的情况。

整体来看,CPO并没有被否定,Scale-out端节奏仍然清晰;保偏光纤在CPO和NPO中仍是关键连接部件;800V HVDC要到2028年后才会真正落地,现阶段仍以正负400V方案为主;电子布尤其是T布处于高度紧缺状态;Q布正在推进英伟达认证;树脂大规模短缺的说法并不成立;Rubin平台虽然带动MLCC场景增加,但单颗GPU对应MLCC用量并非简单上升。

01|CPO延迟主要指Scale-up端,Scale-out节奏仍在推进

近期关于CPO出货延迟的讨论,核心需要区分Scale-up和Scale-out两个应用层级。相关报告提到的延迟,主要指Scale-up端落地延迟,并不是Scale-out端应用推迟。

Scale-out端的推出节奏仍然是2026年四季度末开始,2027年实现规模化应用。此前市场上流传的20万、30万甚至100万台CPO出货规模,实际上对应的应是Scale-up端大规模落地后的远期情形,而不是2027年可以直接实现的规模。

更合理的判断是:2027年CPO出货如果达到4万至10万台,就已经是相当不错的结果。市场上关于2027年20万至30万台的说法明显偏乐观。相关报告真正修正的是此前过度夸大的出货规模预期,而不是否定CPO在2026年四季度启动出货、2027年Scale-out放量的节奏。

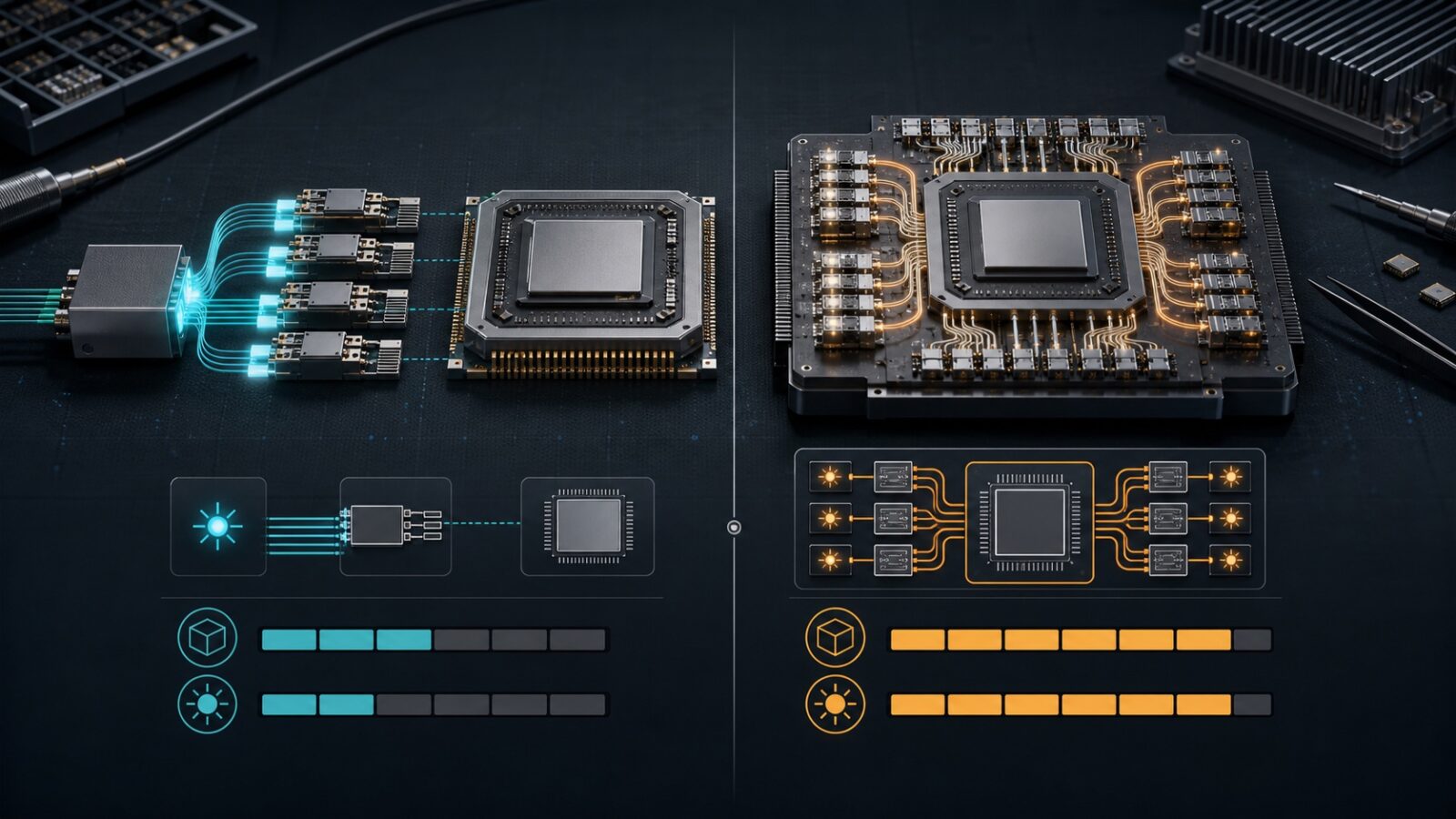

02|CPO良率不能用单颗良率连乘计算

市场上曾出现用0.95的32次方计算CPO系统良率的方式,并由此得出约19%的系统良率。这种算法不符合实际生产良率逻辑,更像是制造市场恐慌的数字游戏。

一台CPO设备中可能包含32颗甚至未来64颗PIC/EIC封装光引擎。如果简单把单颗良率连续相乘,即使单颗良率达到99%,最终系统良率也会被算得很低。这种算法不能代表真实制造良率。

正确方式是:先筛选出100%无故障的光引擎,再进行组配,组配完成后的产品良率才是系统整体良率。行业常规系统良率大约在90%左右,年底目标如果能达到85%至90%,已经属于较高水平。不能从上游材料或单环节良率开始层层相乘,否则从磷化铟、封装、光引擎一路乘下来,任何复杂系统都会被算成极低良率,这显然不符合生产实践。

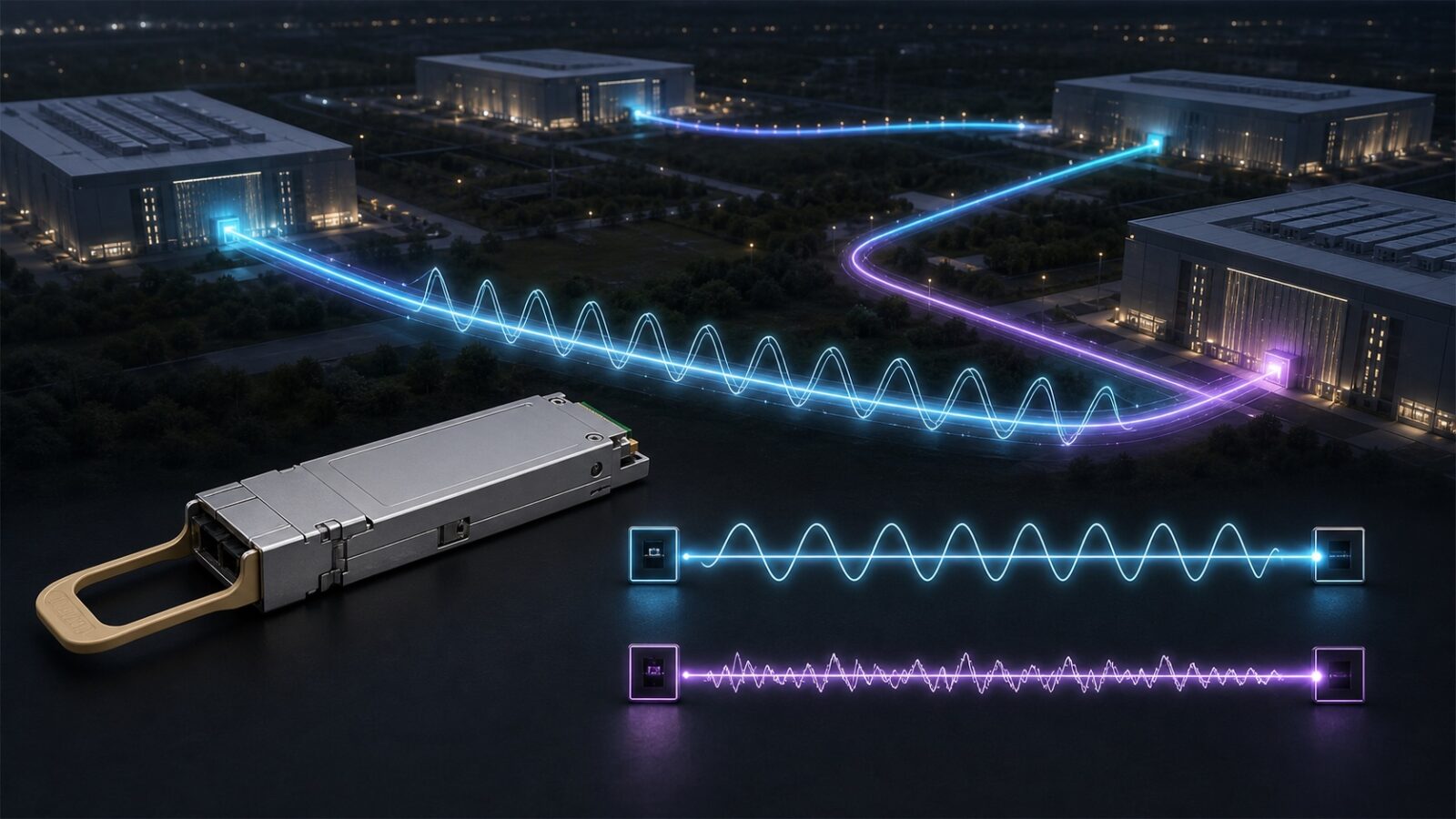

03|CPO和NPO都需要保偏光纤,用量差异不大

保偏光纤是CPO和NPO中的关键连接部件,主要用于光源模组和光引擎之间的连接。只要交换机传输速率一致,NPO和CPO对应的3.2T光引擎使用数量基本一致,因此保偏光纤使用根数也基本相同。

市场上关于NPO中某些器件用量是CPO两倍的说法缺乏依据。NPO和CPO的结构差异主要体现在光引擎与ASIC芯片之间的位置关系,距离差异通常只有5至10厘米。相比保偏光纤总长度几十厘米甚至接近1米的水平,这种长度差异不会显著改变整体用量。

因此,即使CPO落地节奏慢于市场最乐观预期,NPO先行落地也不会削弱保偏光纤的产业逻辑。只要NPO或CPO成为高带宽交换机方案的一部分,保偏光纤仍然是核心增量材料。

04|800V HVDC要到2028年后落地,当前主线仍是正负400V

800V HVDC并不是2026年至2027年的主线方案。更现实的节奏是,800V HVDC要到2028年之后才会逐步落地。现阶段CSP厂商仍以正负400V方案为主。

因此,市场把800V HVDC落地时间延后理解为“超预期延期”并不准确。此前多份产业链纪要和行业交流中,800V方案本身就是2028年后才具备更明确落地条件。2026年至2027年更值得跟踪的是正负400V HVDC方案的导入节奏、电源管理板、服务器机柜供电架构,以及电源供应链切换带来的结构性机会。

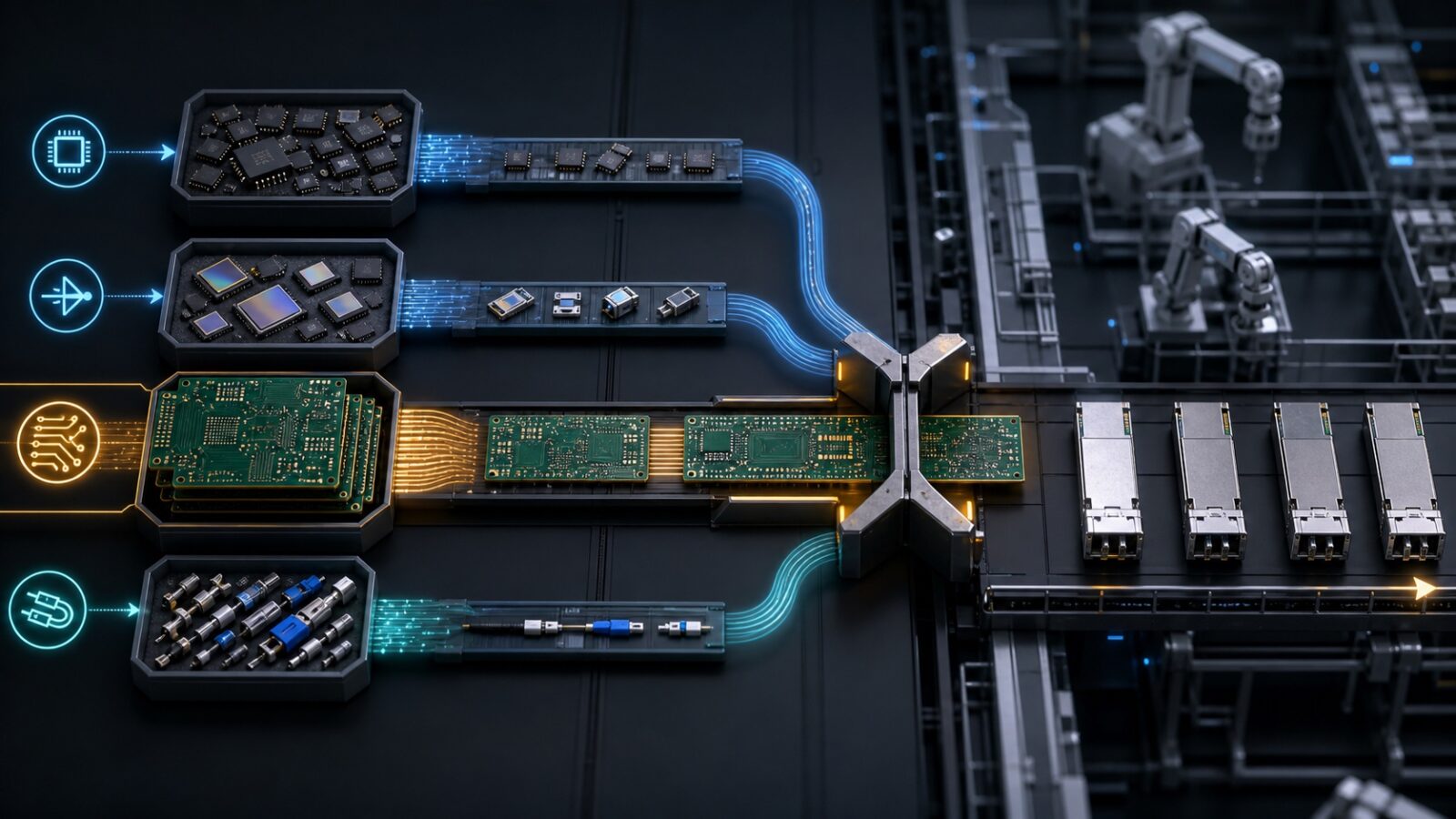

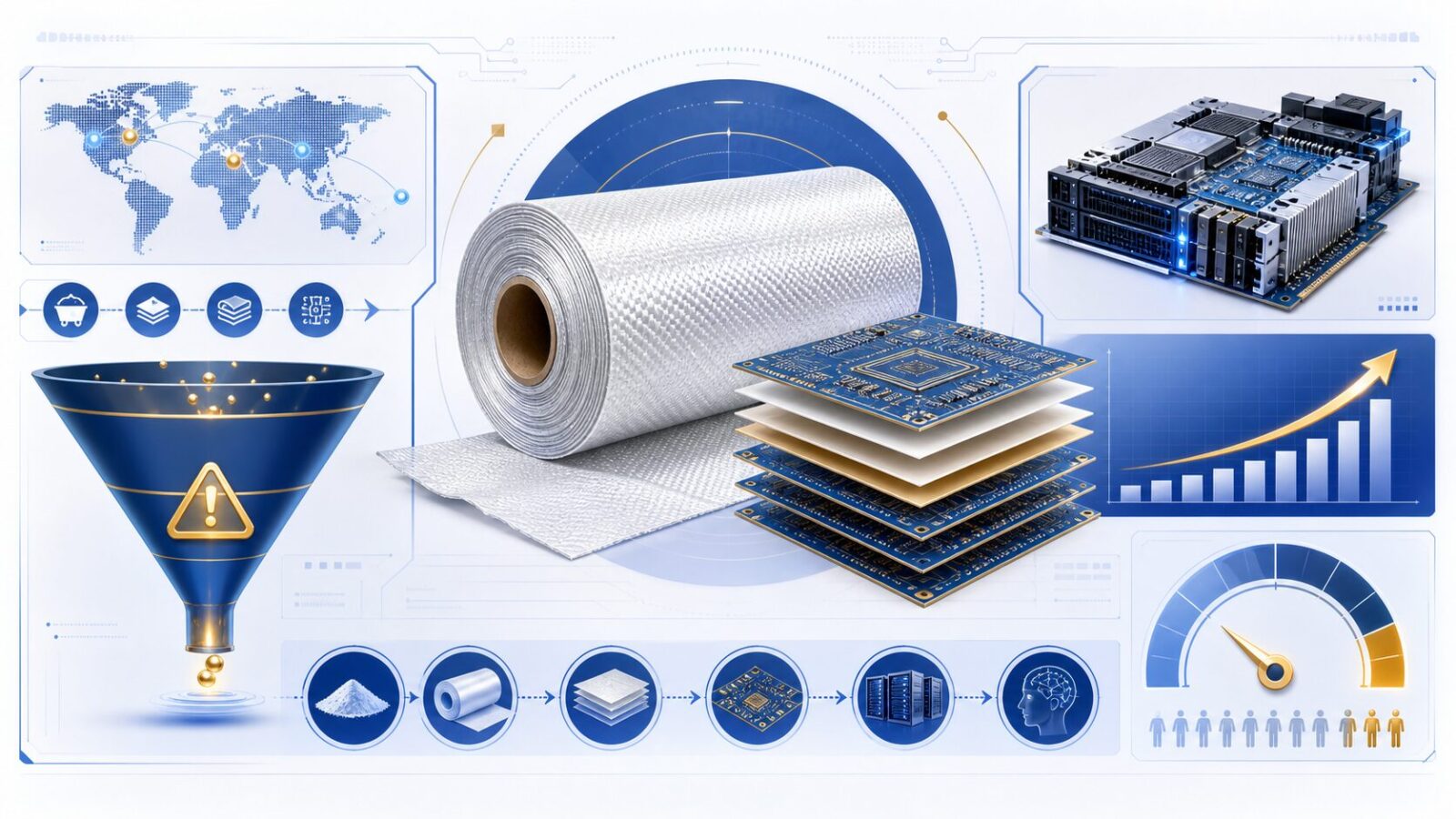

05|电子布分为普通E玻璃布和特种布,不能混淆品类

电子布首先分为普通E玻璃布和特种布。普通布就是E-glass,不属于特种布。特种布包括一代布、二代布、三代布,以及T布、Q布等细分品类。Low DK布也属于特种布体系。

从全球产能看,普通布总产能约36亿米,而特种布总产能约1亿米,二者体量差距非常大。特种布产能只有普通布的约三十六分之一到四十分之一。普通E玻璃布仍然是全球用量最大的电子布品类,几乎所有电子器件都需要使用。

理解这一分类非常重要。AI硬件对高频高速材料需求提升,拉动特种布景气度,但普通布价格上涨并不代表所有电子布都是同一逻辑。普通布的供需紧张更多来自传统需求增长和产能转向特种布后的结构性错配。

06|普通E玻璃布价格持续上涨,薄布紧缺最明显

2026年普通E玻璃布价格持续上涨,并且从年初开始基本每个月调价。普通布中,薄布涨幅明显高于厚布,6月份涨幅进一步扩大,市场紧缺程度较高。

以1080型号普通布为例,一季度每米涨幅约0.3至0.5元,二季度前两个月每月上涨约0.5元,6月份涨幅扩大到每米0.7至0.9元,目前价格已涨至约9.6至9.9元/米。

普通布涨价的核心原因有两个:一是传统业务需求本身在持续增加;二是特种布利润更高,很多电子布厂商将部分产能转向特种布,导致普通布供应减少。理论上,如果没有产能转向,普通布产能本身可以满足市场需求,但转产造成了阶段性错配。

预计厚布价格在2026年三季度后可能趋于稳定,因为巨石、建滔等企业下半年有电子纱产能释放。不过薄布受织布机瓶颈约束更强,价格上涨可能持续到四季度。

07|国产织布机仍是电子布扩产卡点

电子布扩产并不只取决于电子纱产能,还取决于织布机。头部电子布企业使用的织布机主要来自丰田。国产织布机在精度、稳定性、张力控制等方面,与丰田产品仍有明显差距。

目前国产织布机主要能生产厚度较高的普通布,薄布暂时无法实现稳定量产。薄布对平整度、尺寸精度和张力控制要求更高,因此国产设备短期难以替代进口丰田织布机。

山东日发被认为是国内织布机领域技术基础较扎实的企业,但要通过主流客户认证仍面临较大阻碍。泰坦近期受到市场关注,但其过去主要做民用织布设备,切入电子布织布机赛道时间较短,目前虽有样机,但实际性能仍需验证。

丰田织布机年产能约2000台,货源基本被头部企业锁定,中小厂商很难采购到设备。织布机环节可能拉长普通布和特种布供需错配周期,预计2027年上半年这一困境仍难以完全改善。

08|T布是当前最紧缺的上游材料品类

在电子布体系中,T布是目前供需最紧张的品类,紧缺程度高于二代布、三代布、普通布和一代布。T布紧缺已经达到客户需要提前支付保证金锁定产能的程度,部分终端客户甚至会主动与厂商讨论扩产,并提供无息贷款等支持条件。

宏和T布核心下游大客户包括力森诺科、三菱瓦斯、松下,其次是斗山、台光、生益科技等。终端核心客户包括英特尔、苹果。英伟达T布采购主力仍来自日东纺,宏和T布正在推进英伟达供应商认证。

T布在载板领域应用落地较快。国际复材也布局二代布和一代布,其中二代布主要供给生益科技,并依托生益科技渠道进入英伟达供应链。

2026年T布规划出货量约800万米,但企业仍在对接存储领域新客户,后续实际订单规模可能高于当前规划。

09|T布价格跟随日东纺,涨价温和但趋势明确

T布2026年年初价格已上调20%左右,日东纺年初涨价约30%,预计2026年三季度还可能再上调20%。由于日东纺是T布核心龙头,其定价策略对行业影响很大。

宏和T布定价基本跟随日东纺。对长期合作的大客户,宏和基本对标日东纺价格:日东纺涨价则同步上调,日东纺维持价格则保持稳定。对于临时新增需求的零散客户,宏和可能单独上调价格。

不过,日东纺管理层并不倾向于因为供需紧张而盲目大幅涨价。日系企业更重视长期市场份额和产业链稳定,不希望持续大幅涨价吸引新玩家入局,或扰乱下游合作关系。因此,T布价格有上涨趋势,但大概率不是无序暴涨。

10|日东纺T布产能2027年释放,供需需要动态跟踪

日东纺今年主要是中国台湾厂区产能小幅提升,月产能约60万米,峰值不超过70万米。新建工厂今年以土建施工为主,预计2027年一季度启动设备投产,下半年产能正式释放。

扩产完成后,日东纺T布整体产能将扩大约三倍,2027年月产能有望达到200万至300万米。该扩产所需织布机数量较大,但预计设备货源可以保障,总采购设备不超过200台。

从需求看,2027年T布需求预计较2026年基本翻倍,2028年需求可能在2026年基础上翻三倍,整体体量达到7000万米级别。这里存在一个阶段性供需错配风险:如果日系厂商2027年产能翻三倍,而需求只翻倍,则2027年下半年后供需可能逐步趋于平衡。因此,2027年需要重点跟踪T布产能释放节奏和需求兑现情况。

11|宏和特种布产能接近翻倍,重点扩Low DK和薄型普通布

宏和的扩产规划包括巴西项目和黄石电子材料产业园。其最初规划中特种布月产量约300万至350万米,后续又规划新增200万至300万米特种布产能。

Low DK二代布表现较好,宏和规划特种布后续月产能达到400万米,再叠加Low DK一代布每月500万米产能。本次新增产能规模约200万至300万米,扩产完成后相关品类总产能约500万米,特种布产能接近翻倍,增幅约48%。

除特种布之外,宏和新增产能也将重点布局超薄款和薄款普通E玻璃布。考虑到薄布是当前普通布中最紧缺的品类,相关产能释放将影响2027年普通布价格和供需格局。

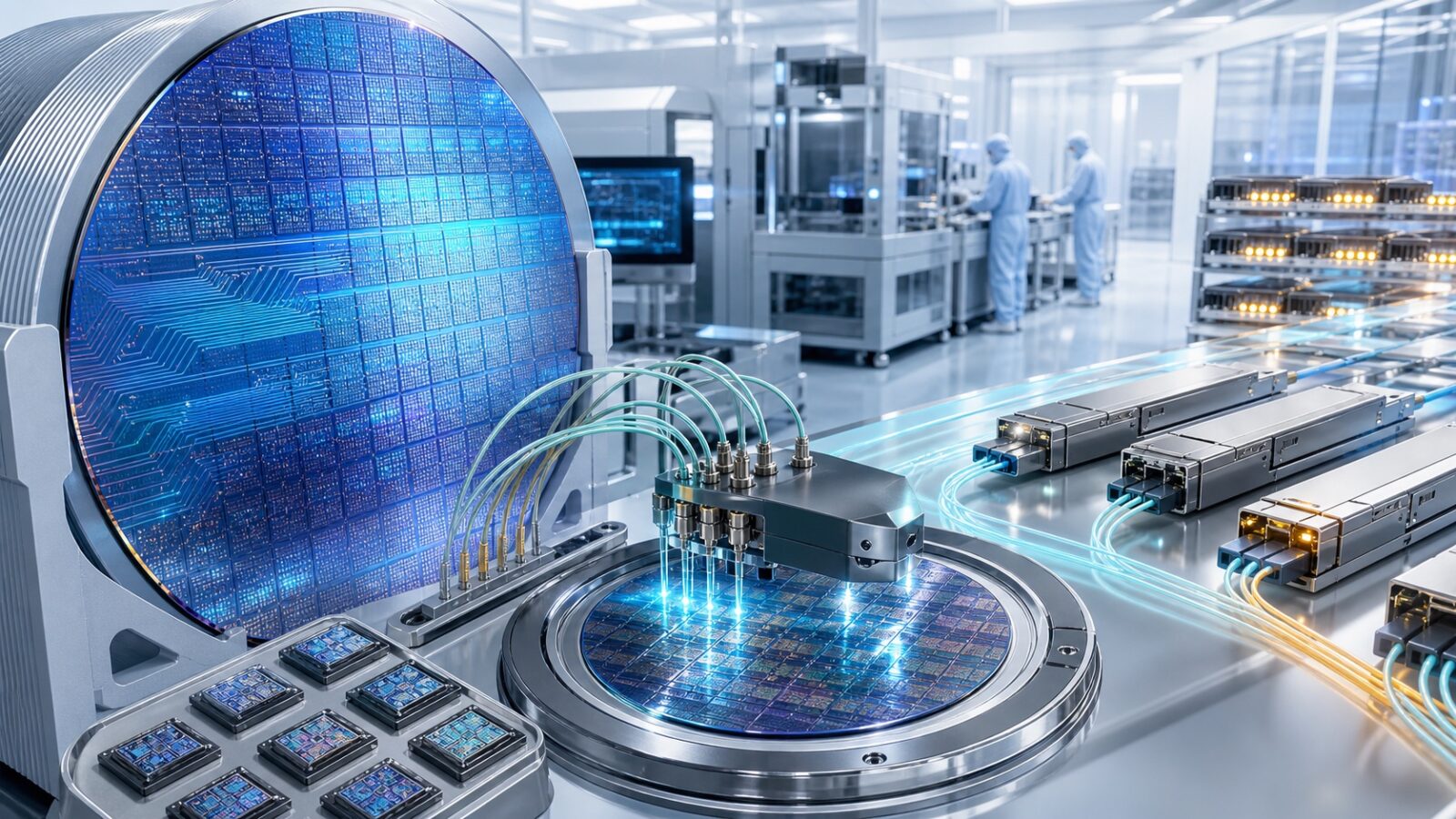

12|Q布已向英伟达递交样品,大规模量产预计在2027年

Q布属于特种布范畴,当前宏和已经向英伟达递交Q布样品,认证流程尚未完成,但产业判断通过概率较高。后续供应链仍需经过小批量、中批量测试,大规模量产出货预计要到2027年,2026年主要应用在8卡设备上。

石英布赛道中,日本旭化成、信越实力较强,日东纺属于后期入局者。国内企业中,飞利华、泰山表现较好,其中泰山具备全产业链能力,可以自主生产石英纤维并加工成石英布。目前国内外头部厂商的石英布仍处于小批量出货阶段,主要用于小型终端设备和测试项目。

客户方面,台光主要采购泰山石英布,生益科技更多选用飞利华产品。未来Q布需求存在变数,但Rubin Ultra正交背板采用Q布这一点较为明确,该应用后续会逐步放量。

13|Rubin Ultra大概率采用Q布M9为主体的混压方案

Rubin Ultra项目主板材料方案大概率不是单一材料,而是混压方案。主体预计以Q布M9为核心,并选取6至8个板材层搭配PTFE材料。

Q布性能受到关注,但自身也存在明显缺点。其材质硬、脆性大,生产良率偏低,加工难度高,在PCB钻孔过程中会加剧钻头损耗,大批量生产效率不足。因此,部分项目会选择技术降级,改用二代布甚至一代布。

PTFE介电常数极低,是其最大优势;但作为热塑性材料,受热后热膨胀系数表现较差,综合性能不如常规电子布,几乎无法单独投入使用。PTFE目前在覆铜板领域应用较多,未来更可能以混压方式进入高端AI服务器主板,而不是完全替代电子布。

综合来看,Rubin Ultra更可能采用Q布为主体、PTFE局部搭配的混压结构,而不是单一路线。

14|树脂大面积短缺和大幅涨价的说法不成立

近期有传闻称树脂存在70%供给缺口、价格上涨78%。这一说法缺乏产业验证。截至目前,并没有企业传出树脂产能大面积紧缺的消息。

树脂确实受到上游原料涨价影响,可能出现小幅调价,但这不同于大规模供给短缺。即使在供应链流通受阻阶段,也没有出现树脂行业大面积缺货。

因此,当前AI材料产业链中真正紧缺的核心不在树脂,而在T布、部分特种布、薄型普通布、Q布认证与量产、织布机设备,以及高端PCB材料组合方案。

15|玻璃基板短期难以全面替代传统基板

玻璃基板被认为是先进封装和载板材料升级方向之一,但当前整体落地节奏仍然较早。无论是中介层还是玻璃芯Glass Core板,规模化应用大概率要到2029年之后。

玻璃基板综合性能较好,但也存在钻孔加工难度高等明显短板。从小批量验证到大规模量产,通常至少需要一至两年,更多情况下需要两至三年。即使2029年启动应用,也可能只是小批量试产。

玻璃基板大概率会先在高要求细分领域落地,而不是短期全面替代传统基板。传统ABF载板、电子布、Q布、PTFE混压方案仍将在较长时间内占据主流位置。

16|Rubin平台带动MLCC场景增加,但单颗GPU用量下降

MLCC相关报告更多是给市场热度降温。Rubin平台确实会带动MLCC整体使用场景增加,但单颗GPU对应的MLCC实际用量是下降的。

从产品结构看,英伟达供应链中MLCC变化主要集中在高容产品,低容产品用量基本保持稳定。因此,不能简单理解为Rubin平台会带动所有MLCC品类全面放量。更准确的判断是:MLCC增量集中在结构变化和高容产品,而非单颗GPU用量线性上升。

17|产业判断:2027年上游材料要同时关注扩产和价格拐点

AI硬件产业链上游材料的投资逻辑正在从“全面缺货”进入“分品类、分节奏、分产能兑现”的阶段。2026年,T布、薄型普通布、Q布、部分Low DK材料仍具备较强景气度;但到2027年,随着日东纺、宏和等厂商产能释放,部分材料可能逐渐从供不应求转向供需平衡。

越往后,跟踪扩产节奏越重要。当前阶段,产业链希望企业尽快扩产,以解决供应瓶颈;但到2027年二季度之后,部分材料如果扩产过快,价格和毛利率可能面临压力。

CPO和NPO方面,关键不是短期出货传闻,而是Scale-out是否按节奏落地、Scale-up何时真正放量,以及保偏光纤、光引擎、硅光、光源和先进封装能否形成稳定供应。电子布方面,T布仍是最紧缺品类,Q布是Rubin Ultra的重要材料变量,普通薄布受织布机限制仍有紧缺压力。HVDC方面,2026年至2027年主线仍是正负400V,800V要到2028年后才是更核心变量。

整体来看,AI硬件上游材料的核心机会将集中在:T布、Q布、Low DK材料、薄型普通布、保偏光纤、先进PCB材料、正负400V HVDC,以及具备认证、扩产和客户绑定能力的企业。真正需要警惕的是,在产能集中释放后,部分材料可能从短缺逻辑切换为价格竞争逻辑。